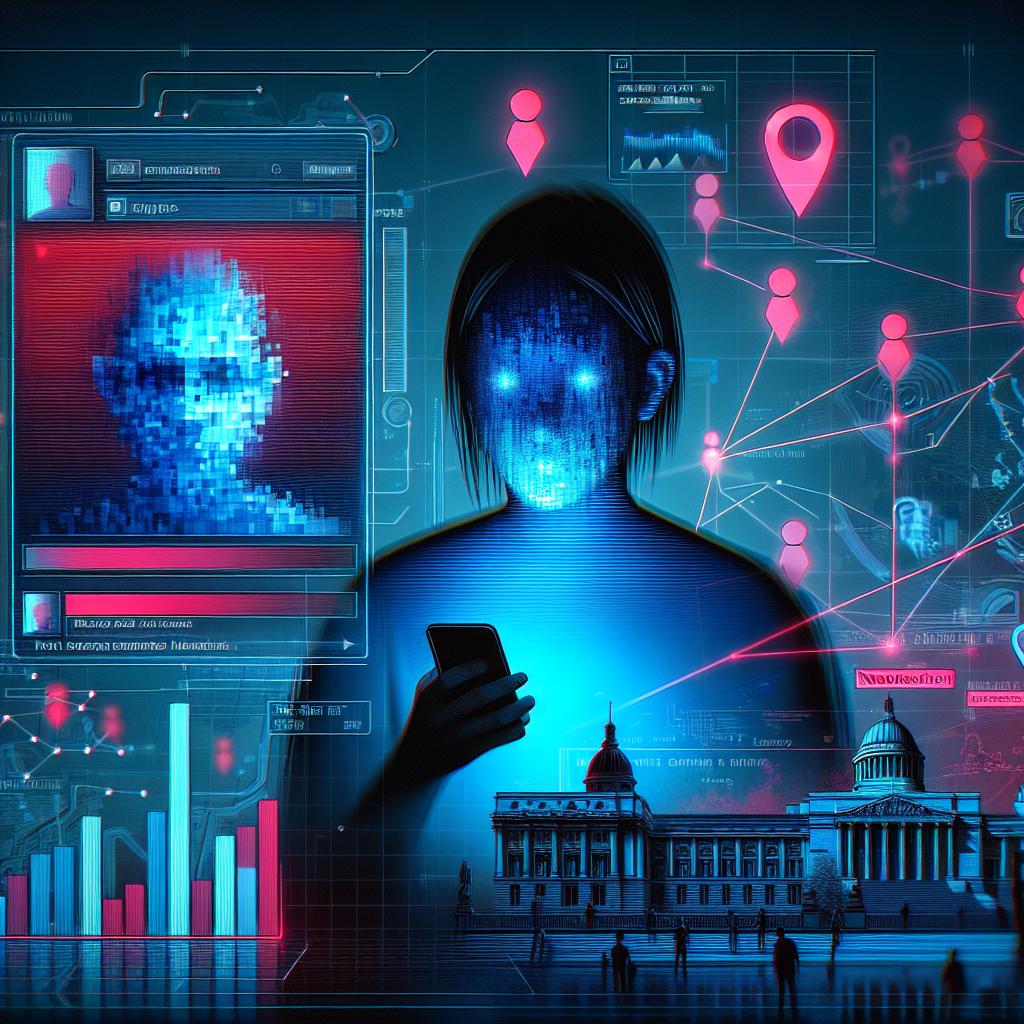

Deepfake du prétendu coup d’État en France : un adolescent burkinabé à l’origine, Macron alerte, Meta critiquée — enjeux de modération et souveraineté numérique

Un adolescent du Burkina Faso a publié un deepfake montrant une fausse journaliste annonçant un « coup d’État », vidéo devenue virale et citée par Emmanuel Macron comme exemple de désinformation et de refus de retrait par Meta. L’affaire illustre les défis de modération, la souveraineté numérique et la propagation interplateformes des contenus manipulés.

C’est un jeune homme méfiant, « un peu stressé, et impressionné », qui a répondu au téléphone après la diffusion d’une vidéo devenue virale début décembre. L’adolescent, qui a demandé à rester anonyme, affirme n’avoir pas anticipé l’ampleur de la diffusion. La séquence mettait en scène de fausses images d’une journaliste, présentée comme s’exprimant depuis Paris pour annoncer un « coup d’État en France » et la prise de pouvoir d’un colonel.

La vidéo et son auteur

La vidéo a été publiée sur une page Facebook administrée par le jeune homme depuis le Burkina Faso et a également été postée sur TikTok par la même personne. Des observateurs ont noté que la séquence présentait « tous les signes d’une génération par intelligence artificielle », une caractéristique désormais récurrente des deepfakes et autres contenus fabriqués numériquement.

Interrogé, l’adolescent a expliqué ne pas avoir voulu provoquer de panique. Il a demandé à garder l’anonymat, citant notamment son inquiétude face à l’attention médiatique et aux possibles conséquences juridiques ou sociales. Il a déclaré ne pas s’attendre à ce que sa publication suscite un tel retentissement.

La réaction d’Emmanuel Macron et la demande de retrait

Le président Emmanuel Macron a cité cette vidéo comme un exemple de désinformation et de difficultés de modération rencontrées par Meta lors d’une rencontre avec des lecteurs du journal La Provence, le 16 décembre. Selon son intervention, l’Élysée aurait demandé à Meta de dépublier la séquence, demande dont, d’après M. Macron, l’entreprise se serait avisément abstenue.

« De manière évidente, ça crée le chaos », a commenté le président, qui a ajouté avoir appris l’existence des images par « un collègue africain » l’ayant contacté après être tombé sur la vidéo aux « 12 millions de vues ». Face au « refus de retrait » évoqué par l’Élysée, le chef de l’État a jugé que les équipes de Meta « se moquent de nous. Ils se moquent de la souveraineté des démocraties et donc ils nous mettent en danger ».

Le président n’a pas précisé, lors de son intervention, si les services de l’État français avaient également demandé à TikTok de retirer la vidéo. Sur ce point, le relais public reste limité au constat formulé par M. Macron et aux déclarations de l’adolescent auteur de la publication.

Modération, plateformes et souveraineté numérique

Ce cas illustre plusieurs questions désormais centrales : la vitesse de propagation des contenus manipulés, la difficulté à identifier leur origine, et la responsabilité des plateformes dans la suppression des contenus manifestement faux ou dangereux. Meta est visée ici pour un refus — tel que rapporté par le président — de retirer des images jugées délétères par l’Élysée.

Les experts qui suivent ces phénomènes soulignent que les contenus générés par intelligence artificielle se multiplient et peuvent être conçus pour contourner les outils automatiques de détection. Dans ce contexte, la frontière entre signalement, évaluation humaine et suppression automatique devient stratégique, en particulier lorsque la diffusion menace la stabilité de l’information publique.

Le partage interplateformes, illustré ici par la publication simultanée sur Facebook et TikTok, renforce la complexité du retrait : une séquence peut rester accessible sur d’autres services même si l’une des plateformes accepte de la retirer. Le récit public du président met par ailleurs en lumière les tensions entre les autorités nationales et les grandes entreprises technologiques sur la gouvernance des contenus.

Conséquences et incertitudes

À la suite de la diffusion, l’adolescent se dit surpris par l’ampleur du phénomène et par l’attention portée à sa publication. Il n’a pas été précisé, dans les éléments disponibles, si des démarches judiciaires ou administratives ciblant l’auteur ou les plateformes avaient été engagées après l’annonce présidentielle.

Le cas rappelle la difficulté à concilier liberté d’expression, sécurité démocratique et responsabilité des hébergeurs. Il met aussi en évidence le besoin d’outils plus performants pour repérer et agir sur les contenus manipulés sans pour autant sacrifier la transparence des processus décisionnels des plateformes.

Enfin, plusieurs points restent flous dans le dossier tel que rapporté publiquement : la chronologie précise des demandes de retrait, la nature exacte des échanges entre l’Élysée et les plateformes, et les réponses formelles éventuelles de Meta ou de TikTok. Ces éléments détermineront en grande partie l’évaluation finale des responsabilités et l’ampleur des mesures à envisager pour limiter la propagation de faux médias à l’avenir.