Quand les interfaces commerciales confisquent le choix: comment les citoyens peuvent repérer et exiger la fin des dark patterns ecommerce

Interfaces qui cachent des options, faux compteurs ou cases précochées: ces pratiques, appelées dark patterns, privent le consommateur du choix. Cet article montre comment régulation, outils de détection et signalements aident à restaurer la transparence en ligne.

Quand un achat en ligne se transforme en parcours d’obstacles, ce n’est pas seulement agaçant. C’est souvent le signe qu’une interface a été pensée pour pousser, retenir ou détourner votre choix.

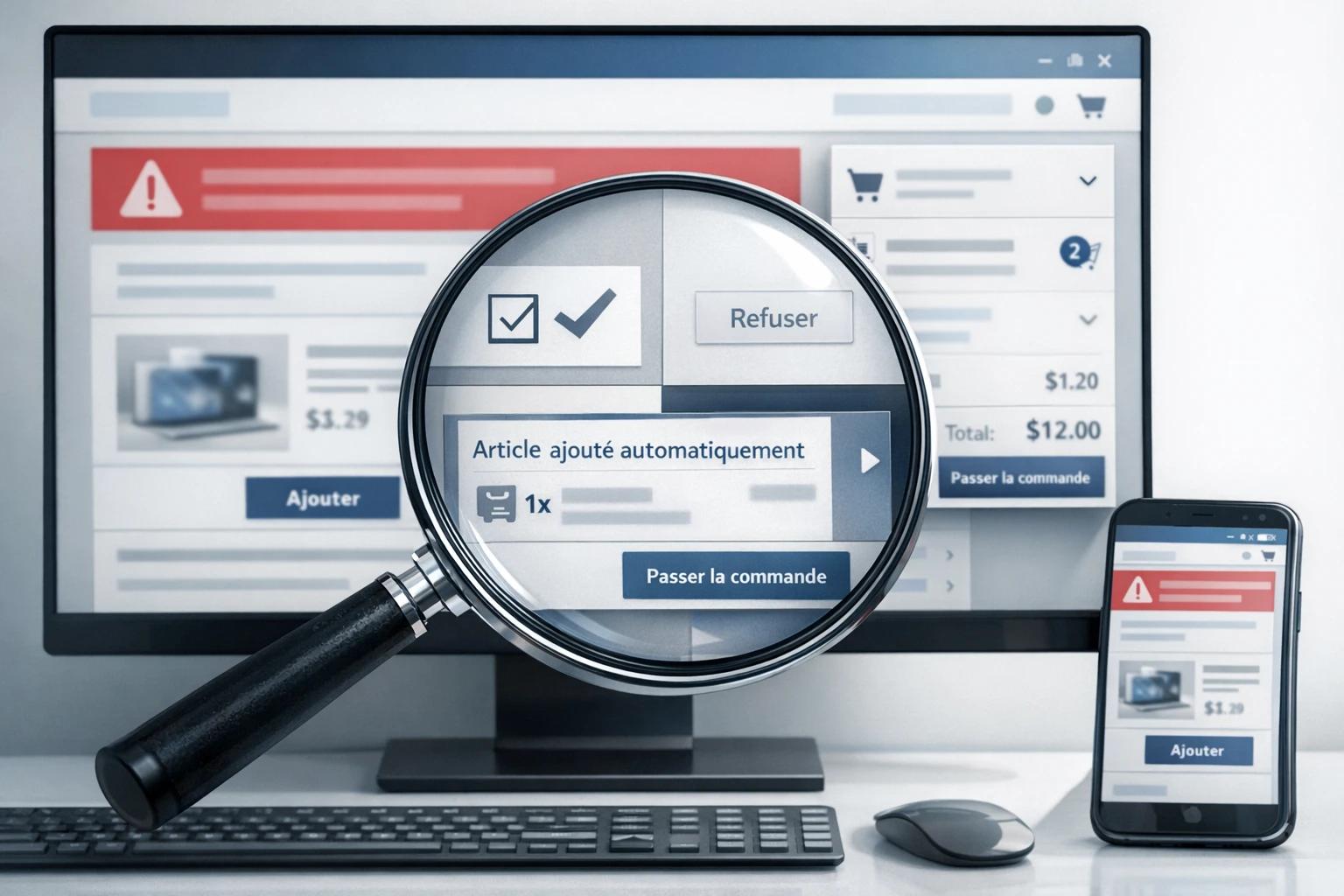

Ces schémas portent un nom: les dark patterns. Une case déjà cochée. Un bouton de refus caché. Une assurance ajoutée au dernier moment. Un faux compte à rebours. Sur le moment, le client croit décider librement. En réalité, le site l’oriente.

Quand la vente en ligne pousse la main du client

Dans le commerce numérique, ce type de mécanique sert un objectif simple: faire monter le panier, capter des données ou vendre une option de plus. Pour les vendeurs, le gain est immédiat. Pour l’utilisateur, la facture peut grimper sans qu’il s’en rende compte, ou le consentement peut devenir flou. C’est là que se joue le rapport de force.

Le phénomène n’est pas marginal. La Commission européenne rappelle que 35 % des consommateurs européens ont acheté dans un autre pays de l’Union en 2024, et que la probabilité de rencontrer un problème lors d’un achat en ligne dépasse de plus de 60 % celle d’un achat hors ligne. Elle note aussi que 93 % des acheteurs en ligne s’inquiètent des publicités ciblées. Autrement dit, l’achat numérique est devenu banal, mais la méfiance aussi.

La DGCCRF a déjà posé un cadre clair. Sur sa fiche consacrée aux dark patterns, elle cite les compteurs de temps, les stocks affichés comme urgents, les offres additionnelles ajoutées sans consentement explicite, ou les messages qui pressent à cliquer sans vérifier. Elle rappelle que ces pratiques peuvent relever de la tromperie, de la déloyauté ou de l’agressivité commerciale. La fiche est accessible ici: la fiche de la DGCCRF sur les dark patterns en e-commerce.

Le service public SignalConso va dans le même sens. Il présente ces interfaces comme des techniques conçues pour tromper ou manipuler l’utilisateur et invite à les signaler. Pour le consommateur, l’intérêt est évident: reprendre la main. Pour l’entreprise, l’enjeu est moins confortable: corriger avant que la sanction ne tombe.

L’IA accélère le problème, mais peut aussi le corriger

L’arrivée de l’IA générative a changé l’échelle. Elle permet de produire plus vite des textes, des visuels, des variantes de pages et des messages commerciaux. En pratique, cela peut industrialiser la persuasion. Une équipe marketing peut tester davantage de formulations, de couleurs, de placements ou de slogans, jusqu’à trouver ceux qui déclenchent le clic le plus vite.

C’est précisément sur ce terrain qu’avance Fair Patterns. La jeune pousse française propose une IA multimodale capable de repérer des schémas trompeurs dans le texte, le design et le code, puis de suggérer des corrections. Son idée est simple: détecter les pièges avant qu’ils ne passent en production, au lieu d’attendre qu’un contrôle ou une plainte les mette en lumière.

Pour les entreprises volontaires, l’intérêt est double. D’abord, elles réduisent le risque juridique et réputationnel. Ensuite, elles gagnent en lisibilité. Une interface claire retient peut-être moins par la pression, mais elle inspire davantage confiance. Dans un marché saturé de sollicitations, cette confiance peut aussi devenir un avantage commercial.

Le bénéfice n’est pas le même pour tout le monde. Les grandes plateformes disposent d’équipes produit, juridiques et data capables d’industrialiser ces audits. Les petites structures, elles, cherchent souvent des outils plus simples pour éviter les erreurs. Entre les deux, le terrain est très inégal. Une solution d’IA peut donc aider à corriger, mais elle peut aussi devenir un coût supplémentaire si elle reste réservée aux acteurs les mieux dotés.

Une régulation déjà dense, mais encore sous tension

Le droit n’attend pas l’IA pour agir. Le règlement européen sur les services numériques interdit les dark patterns sur les plateformes en ligne. En France, cette interdiction s’applique depuis le 17 février 2024. La Commission européenne explique qu’il s’agit d’empêcher les interfaces de tromper les utilisateurs pour les pousser vers un choix qu’ils n’auraient pas fait autrement.

La DGCCRF rappelle aussi que les sanctions peuvent être lourdes. Une pratique commerciale trompeuse ou déloyale peut conduire à 300 000 euros d’amende et deux ans de prison pour une personne physique. Pour une personne morale, la sanction peut atteindre 1,5 million d’euros, avec des plafonds encore plus élevés selon l’avantage tiré de l’infraction. Le message est clair: la manipulation commerciale n’est pas un simple défaut d’ergonomie.

Le volet IA renforce encore cette logique. L’AI Act européen interdit depuis le 2 février 2025 les pratiques d’IA qui manipulent ou exploitent les vulnérabilités de manière dangereuse. Il ajoute aussi des obligations de transparence, avec une mise en application prévue à partir d’août 2026. Si un chatbot ou un contenu généré peut peser sur une décision commerciale, il doit être clairement identifiable.

Bruxelles prépare en parallèle une future législation sur l’équité numérique. La Commission veut y traiter les interfaces trompeuses, les pratiques de personnalisation injustes, les designs addictifs et les usages qui exploitent les fragilités des consommateurs. Les autorités reconnaissent donc un point simple: le problème ne tient pas seulement à quelques boutons mal placés, mais à une économie de la captation d’attention.

Pourquoi le débat dépasse la seule e-commerce

Le sujet touche à la confiance, mais aussi à la concurrence. Les entreprises qui jouent la carte de la transparence peuvent perdre un peu de conversion à court terme. Celles qui forcent la main gagnent parfois plus vite. C’est exactement ce déséquilibre que cherchent à corriger les régulateurs et les associations de consommateurs.

L’UFC-Que Choisir a montré en 2024 que les 20 principales places de marché qu’elle avait examinées utilisaient toutes des dark patterns, malgré leur interdiction sur les plateformes en ligne. L’association y voit la preuve qu’une simple promesse de conformité ne suffit pas. Pour elle, les autorités doivent contrôler plus, sanctionner plus et imposer des changements réels. Sa position est claire: la bonne volonté des acteurs ne remplace pas l’application de la règle.

Cette critique vise surtout les grands acteurs, capables de multiplier les tests A/B et de pousser toujours plus loin l’optimisation comportementale. Les petits commerçants, eux, subissent souvent les mêmes contraintes de conformité sans disposer des mêmes ressources. C’est là qu’un outil comme celui de Fair Patterns peut servir: pas pour blanchir des pratiques douteuses, mais pour éviter que la conformité ne devienne un privilège réservé aux plus gros.

Reste une question de fond. Si une entreprise utilise une IA pour corriger ses interfaces, cherche-t-elle à mieux respecter ses clients, ou à mieux se protéger d’un futur contrôle ? Les deux objectifs peuvent coexister. Mais ils ne disent pas la même chose sur la culture de l’entreprise.

Ce qu’il faut surveiller dans les prochains mois

Le calendrier européen reste décisif. Les obligations de transparence de l’AI Act doivent entrer en application en août 2026. Et la future loi sur l’équité numérique dira si l’Union veut seulement corriger les interfaces les plus voyantes, ou aussi s’attaquer aux ressorts commerciaux qui les produisent.

Le point de vigilance est simple: dans un commerce en ligne devenu quotidien, le client garde-t-il vraiment la main, ou seulement l’illusion du choix ? C’est cette frontière que les entreprises, les régulateurs et les associations vont continuer à tester.